日前,小米正式推出全新基础语言模型MiMo-V2-Flash,并同步宣布将其开源。这款模型主打高效与超高速核心特性,在推理、代码生成及智能体等专业场景中表现突出,同时也可胜任日常任务处理,充当通用型AI助手。

模型上线后,不少网友第 一时间展开实测,其响应速度成为最受关注的亮点。有用户反馈,MiMo-V2-Flash在问题响应效率上显著优于豆包、DeepSeek、元宝等同类模型,超快的回答速度超出预期,展现出强劲的性能优势。

参数层面,MiMo-V2-Flash拥有3090亿总参数量与150亿激活参数量,凭借出色的架构设计,在多项公开基准测试中表现优异,已成功跻身当前开源大模型第 一梯队。值得一提的是,该模型的权重与推理代码均采用MIT协议全面开源,为开发者社区提供了充足的探索空间。

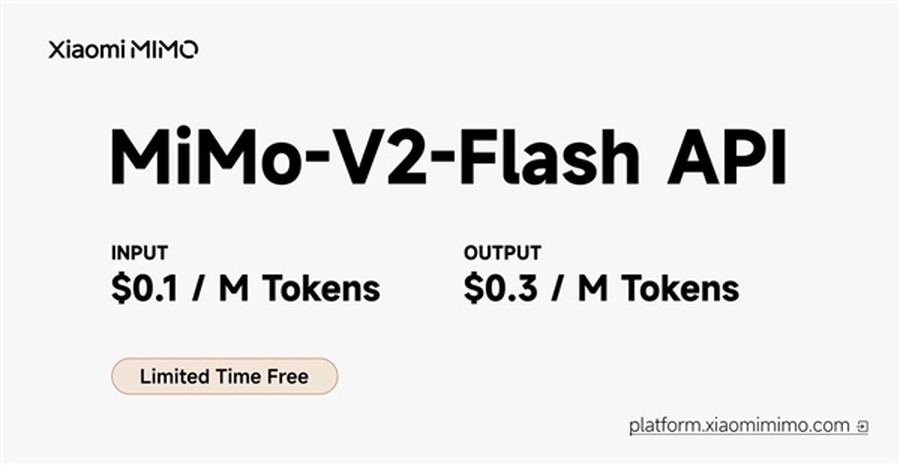

成本方面,MiMo-V2-Flash也展现出极高的性价比,其API定价为每百万输入Token 0.1美元、每百万输出Token 0.3美元,且目前正提供限时免费使用福利,大幅降低了用户与开发者的使用门槛。

值得关注的是,小米今日将举办人车家全生态合作伙伴大会,据业内推测,大会期间或许会公布MiMo-V2-Flash的更多技术细节,进一步揭晓这款高性能大模型在全生态场景中的应用规划。